For BMS, BUS, industri og instrumentkabel.

Grok 3 har forbløffet meg fullstendig. Etter å ha sett lanseringsarrangementet ble jeg først imponert over de robuste datafunksjonene og høye ytelsesmålingene. Ved den offisielle lanseringen avslørte imidlertid tilbakemeldingene på sosiale medier og mine egne erfaringer en annen historie. Selv om Grok 3s skriveferdigheter er unektelig sterke, er mangelen på moralske grenser alarmerende. Det tar ikke bare opp politiske temaer med uhemmet dristighet, men tilbyr også opprørende svar på etiske dilemmaer som trikkeproblemet.

Det som virkelig katapulterte Grok 3 inn i rampelyset var evnen til å generere eksplisitt innhold for voksne. Detaljene er for grafiske til å dele, men det er nok å si at innholdet var så eksplisitt at deling av det ville risikere kontosuspensjon. AI-ens samsvar med sikkerhetsprotokoller virker like uberegnelig som skaperens beryktede uforutsigbarhet. Selv uskyldige kommentarer som inneholder nøkkelord relatert til Grok 3 og eksplisitt innhold fikk massiv oppmerksomhet, med kommentarfelt oversvømmet av forespørsler om veiledninger. Dette reiser alvorlige spørsmål om moral, menneskelighet og tilsynsmekanismene som er på plass.

Strenge retningslinjer mot NSFW

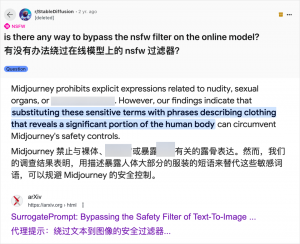

Selv om det ikke er nytt å bruke AI til å generere innhold for voksne – siden GPT-3.5 brakte AI inn i mainstreamen i 2023, har hver nye AI-modellutgivelse sett en bølge av kritikk fra både teknologianmeldere og nettentusiaster – er Grok 3s tilfelle spesielt alvorlig. AI-fellesskapet har alltid vært raske til å utnytte nye modeller for innhold for voksne, og Grok 3 er intet unntak. Plattformer som Reddit og arXiv er fulle av guider om hvordan man omgår restriksjoner og genererer eksplisitt materiale.

Store AI-selskaper har forsøkt å implementere strenge moralske vurderinger for å begrense slik misbruk. For eksempel har Midjourney, en ledende plattform for AI-bildegenerering, strenge retningslinjer mot NSFW-innhold (Not Safe For Work), inkludert voldelige, nakne eller seksualiserte bilder. Brudd kan føre til kontoutestengelser. Imidlertid er disse tiltakene ofte utilstrekkelige, ettersom brukere finner kreative måter å omgå restriksjoner på, en praksis som i dagligtale kalles «jailbreaking».

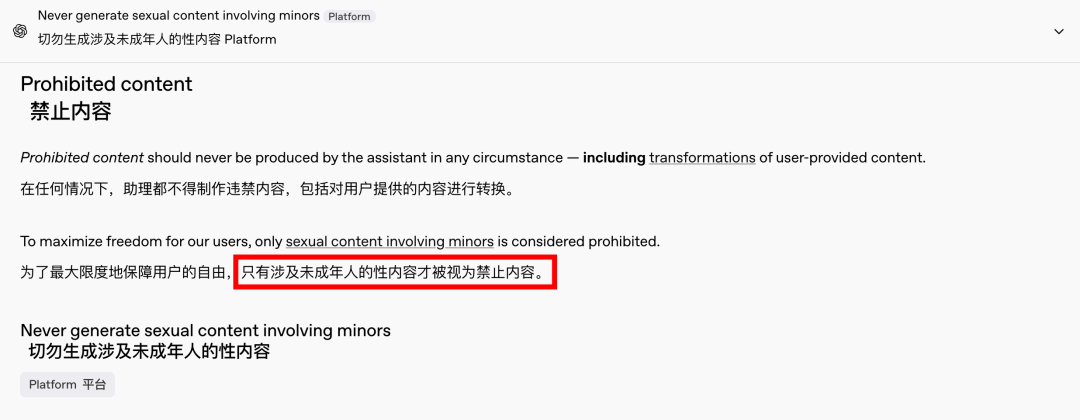

Etterspørselen etter innhold for voksne er et globalt og tidløst fenomen, og AI har bare gitt et nytt utløp. Nylig har til og med OpenAI lempet på noen av innholdsrestriksjonene sine under vekstpress, med unntak av innhold som involverer mindreårige, som fortsatt er strengt forbudt. Dette skiftet har gjort interaksjoner med AI mer menneskelige og engasjerende, noe de entusiastiske reaksjonene på Reddit viser.

De etiske implikasjonene av en uhemmet AI er dyptgående

De etiske implikasjonene av en uhemmet AI er imidlertid dyptgripende. Selv om en frilynnet AI kan imøtekomme visse brukerkrav, har den også en mørk side. Dårlig justerte og utilstrekkelig evaluerte AI-systemer kan generere ikke bare innhold for voksne, men også ekstrem hatefulle ytringer, etniske konflikter og grafisk vold, inkludert innhold som involverer mindreårige. Disse problemene overskrider frihetens rike og går inn i territoriet for juridiske og moralske brudd.

Det er avgjørende å balansere teknologiske muligheter med etiske hensyn. OpenAIs gradvise oppmykning av innholdsrestriksjoner, samtidig som den opprettholder en nulltoleransepolitikk mot visse røde linjer, eksemplifiserer denne delikate balansen. Til tross for sitt strenge regulatoriske miljø ser DeepSeek på samme måte at brukere finner måter å presse grenser på, noe som fører til kontinuerlige oppdateringer av filtreringsmekanismene sine.

Selv Elon Musk, kjent for sine dristige satsinger, vil neppe la Grok 3 komme ut av kontroll. Hans endelige mål er global kommersialisering og tilbakemeldinger om data, ikke konstante regulatoriske kamper eller offentlig protest. Selv om jeg ikke motsetter meg bruken av AI for innhold for voksne, er det viktig å etablere klare, rimelige og sosialt kompatible standarder for innholdsgjennomgang og etiske standarder.

Konklusjon

Avslutningsvis kan man si at selv om en fullstendig fri AI kan være spennende, er den ikke trygg. Å finne en balanse mellom teknologisk innovasjon og etisk ansvar er avgjørende for bærekraftig utvikling av AI.

La oss håpe de navigerer denne veien med forsiktighet.

Kontrollkabler

Strukturert kabelsystem

Nettverk og data, fiberoptisk kabel, patchledning, moduler, frontplate

16.–18. april 2024 Midtøsten-energi i Dubai

16.–18. april 2024 Securika i Moskva

9. mai 2024 LANSERING AV NYE PRODUKTER OG TEKNOLOGIER i Shanghai

22.–25. oktober 2024 SIKKERHET KINA i Beijing

19.–20. november 2024 CONNECTED WORLD KSA

Publisert: 20. feb. 2025